株式会社メルカリの研究開発組織 「mercari R4D(アールフォーディー)」(以下、R4D)と生成AI/LLM専門チームは、大阪大学社会技術共創研究センター(以下、大阪大学ELSIセンター)との「ELSI」(Ethical, Legal and Social Issues/エルシー)に関する共同研究に基づいて、「LLMを用いたプロダクト開発をスピーディーに行うためのガイドライン」を策定いたしました。

本ガイドラインは、LLMの既存モデルをプロダクトに適用する等、特に開発担当者向けに汎用性の高いユースケースとそのリスク対策、手続きについてまとめています。自社でLLMを利用する場合やガイドラインを策定する際に、手引きとして利用いただける内容となっています。

ガイドラインの概要

ガイドラインは、こちらからPDFをダウンロードいただけます。

「LLMを用いたプロダクト開発をスピーディーに行うためのガイドライン」

※本ガイドラインは、OpenAI社が提供するChat GPT(API連携による利用)を利用する場合を想定しています

<目次>

- 注意事項の概要

- ユースケースに応じたリスク対策と手続き

- LLMの直接的な利用者が従業者である(LLMにより生成したコンテンツを社外に提供する)場合

- LLMの直接的な利用者がお客さまである(LLMそのものをサービスとして提供する)場合

- promptに含むことができる情報

- 利用規約の確認および遵守

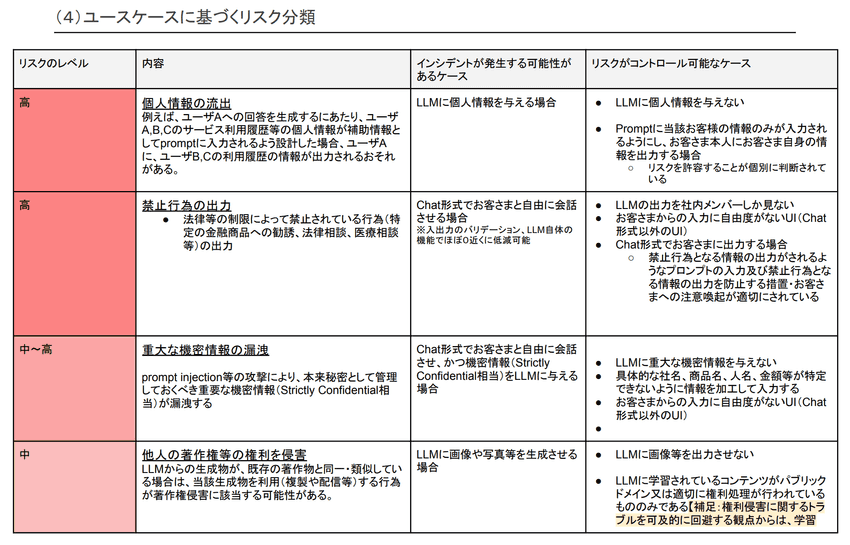

- ユースケースに基づくリスク分類

- ユースケースに応じたリスク対策と手続き

- リスク対策の詳細

- 関連するリスク

- リスク対策の詳細

ガイドライン策定の経緯

R4Dと大阪大学ELSIセンターは、2021年よりELSIに関する共同研究を進めており、メルカリにおける研究開発倫理審査の高度化や新たな技術に対するテクノロジーアセスメントを行ってまいりました。

昨今、生成AIやLLMを利用したサービスが増えている一方、このような新興技術の利用には、サービス提供者の意図しないリスクを引き起こす可能性が存在します。そのため、お客さまが安心安全にサービスを利用できるよう、慎重にリスクを評価することが求められます。 そこで、スピーディーな開発に資するために、R4Dでは「LLMを用いたプロダクト開発をスピーディーに行うためのガイドライン」を策定いたしました。本ガイドラインの策定にあたっては、LLMを用いたプロダクトのユースケースに応じたリスクの洗い出しを行い、洗い出したリスクの対策案について、ELSI観点での議論を頻繁に重ねてまいりました。

ガイドラインを用いた開発プロセスの構築について

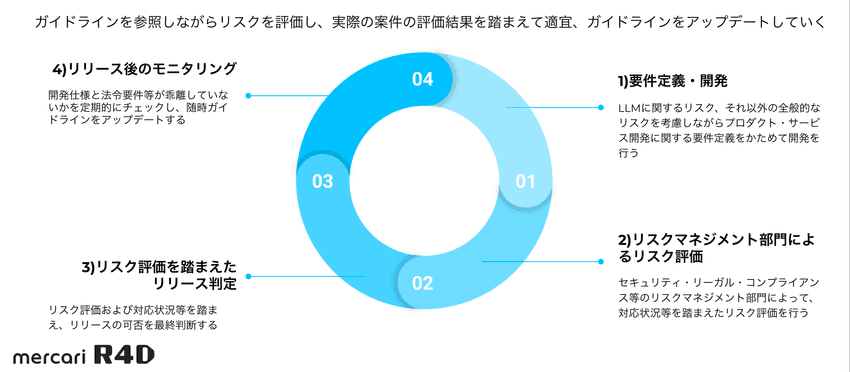

なお、安心安全なサービス設計には、ガイドライン単独に依存するのではなく、プロセス全体でリスクをコントロールすることが重要だと考えております。

<運用例>

以下のプロセスにおいて、ガイドラインを参照しながらリスクを評価し、実際の案件の評価結果を踏まえて適宜、ガイドラインをアップデートしていく仕組みを構築します。

担当者のコメント(R4D Director・多湖)

本ガイドラインは、大阪大学ELSIセンターとの共同研究の一環として議論を重ねて策定しました。大阪大学ELSIセンターとは、本件に限らず、課題発掘のフェーズから検討を行い、適宜、研究領域の枠を超えて研究推進チームを組成し、プロダクト開発より先の社会課題の解決に向けた、”Co-innovaition”的アプローチの活動を幅広く行っています。

今後もR4Dは、産業界やアカデミア、国といった枠を超えてコミュニティをつなぎ、科学技術の力で複雑な社会課題の活動に向けて、連携機関を拡大しながら推進していきます。

今後の展開

本ガイドラインは、あくまで既存モデルの利用に焦点を当てており、Fine tuning利用時や新しいモデルを作る際の論点などには対応しておりません。また、今後、LLMの活用が世界的に促進されるにつれて、現時点ではまだ顕在化していないリスクが顕在化してくることでしょう。R4Dは、本ガイドラインの策定だけで終わらず、状況に応じて定期的にアップデートし、発信していきたいと考えています。

R4DのELSI研究について

ELSIに関する研究ページはこちら https://r4d.mercari.com/elsi/